当逝者“发声”:AI复活死者,是正义的延伸还是伦理的噩梦?

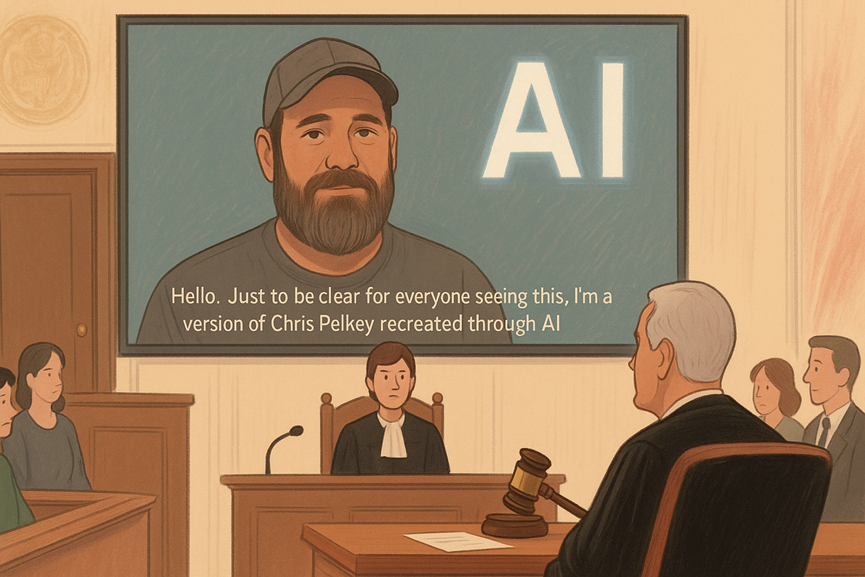

在美国亚利桑那州的一间法庭上,一名早已去世的男子“亲口”对杀害他的人说:

“对那个开枪射杀我的人……我希望我们能以更好的方式见面。”

这句令人毛骨悚然的发言,既不是生前留下的视频,也不是手写日记的朗读。而是一段由人工智能技术生成的“深度伪造”视频 —— 死者克里斯·佩尔基(Chris Pelkey)通过AI图像合成与语音克隆“复活”,在法庭上对凶手进行了“陈述”。

这是全球首例AI复活死者发言被提交至法庭的案件,不仅引发了公众轰动,也将“人工智能在司法系统的伦理边界”推向风口浪尖。

一种全新的受害人陈述方式:AI复活影像走进法院

克里斯的姐姐斯泰西(Stacey Wales)表示,她希望通过这种方式,让陪审团和法官看到“克里斯是个有温度、有个性的人,而不是案件编号上的一个名字”。于是她与AI工程师合作,借助Stable Diffusion图像生成工具和LoRA语音合成模型,基于家人回忆、照片资料,重建了克里斯的形象、声音甚至“情感语调”。

这段AI生成的视频作为**受害者影响陈述(Victim Impact Statement)**的一部分,在凶手加布里埃尔·霍卡西塔斯(Gabriel Horcasitas)的量刑听证会上播放。而更令人震惊的是:法官接受了这段AI视频作为合法材料。

舆论哗然:AI伦理问题在法庭被全面放大

- 法律专家质疑其法律效力与潜在误导性

- AI伦理学家警告这将是“潘多拉魔盒”

- 网友担忧AI复活死者会被滥用

为什么这会引发如此强烈的反应?

因为这段视频并非真正的克里斯发言,而是家属通过人工智能推测、合成的内容。它更像是“对死者立场的再创造”,这让人们不得不思考:

- 谁有权代表死者“发言”?

- AI复活是否可能歪曲事实、误导情感?

- 如果以后AI复活证人也能用于庭审,我们还能信什么是真相?

有人认为这是情感表达的突破,有人却直呼“披着悲伤外衣的深度伪造”。

法律灰区与伦理红线:AI重建证词是否该被允许?

目前,在美国尚无任何法律禁止AI生成的受害人陈述出现在法庭。这起案件也凸显出技术发展远远快于法律制度的应对。

值得注意的是:此次视频只是用于量刑阶段,并未作为审判阶段的证据。但未来呢?

- 谋杀案是否会出现AI复活的“证人”或“受害者”?

- 控方是否会用AI制造情绪冲击,辩方又能否用AI质疑真伪?

- 司法系统是否做好了辨识AI内容真伪的准备?

这一切都还是未知数,但毫无疑问,司法系统必须迅速应对AI技术所带来的新问题。

AI工具不是中立的:“复活”到底还原了多少真实?

此次视频的制作工具全部来自开源社区,包括广泛流传的Stable Diffusion图像模型、自训练的语音克隆模型。创作者甚至对克里斯的发型、胡子、墨镜等细节做了美化处理,以呈现“理想化”的形象。

这不禁令人深思:

这段影像,究竟是多少比例属于真正的克里斯?又有多少是家人对他的“想象”?

随着AI模拟人的能力不断提升,重建亲人的视频可能变得唾手可得。但它也意味着更高的误导风险 —— 尤其是在法庭这种敏感场合。

AI与司法碰撞,我们该如何划清界限?

这起案件让我们不得不直面一个现实:AI已经开始重塑“真相”的定义。

也许AI能帮助人们获得心理慰藉,也许它能带来情感闭环。但同时,它也能被滥用、被操控 —— 尤其是在人类情绪最脆弱的时刻。

当“复活逝者”成为可能,我们如何确保他们说的是“真实的遗愿”,而不是他人代为创作的脚本?

写在最后:AI已然无处不在,关键是你如何使用

克里斯·佩尔基的案例看似极端,甚至带有“赛博科幻”的色彩。但这并不是遥远的未来,而是我们正在经历的现实。

从AI写作助手到图像生成、语音克隆,AI已经走进你我的生活。而如果你正在寻找一个简单、实用又平价的AI平台,那么推荐你试试 XXAI。

XXAI整合了包括GPT-4o、Claude 3.7、Gemini 2.5等全球领先的大模型,为你提供AI写作、翻译、搜索、提示词管理、AI搭档等功能,月费仅需9.9美元起。

AI不再是程序员的专属,它属于每一个普通人。问题是:你,打算怎么用它?